線形代数とデータサイエンス

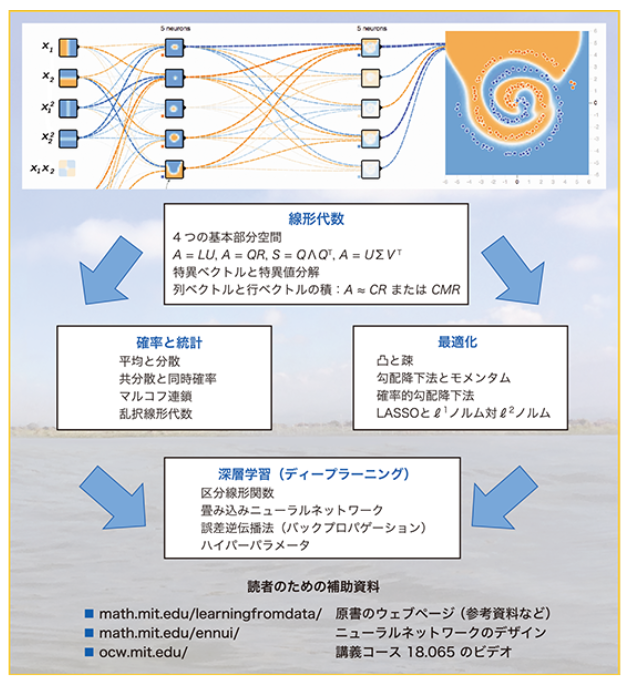

線形代数は、データをベクトルや行列として表現し、幾何と計算を両立して扱うための共通言語である。データサイエンスは、確率・統計と最適化、そして学習モデルを通じて、行列計算を知識抽出へ接続する学問である。

参考ドキュメント

- ギルバート・ストラング(著),松崎公紀(訳),ストラング:線形代数とデータサイエンス,近代科学社.

- 松浦真也,主成分分析と行列の特異値分解,講義資料(PDF).

- 桂田祐史,信号処理とフーリエ変換:離散フーリエ変換に関する講義資料(PDF).

第1章:線形代数の要点

本章では、データサイエンスで繰り返し現れる行列計算を、列空間・直交性・分解という3つの視点で整理する。各節の式変形は、最小二乗・次元削減・学習の更新則へそのまま接続できる形で述べるのである。

1.1 行列Aの列ベクトルを用いた行列ベクトル積 Ax

と表される。すなわち

同じ

同じ積を行ベクトルの側から見ると、

である。各成分は内積であり、特徴ベクトル

計算量の観点では、密行列では

データ行列

1.2 行列-行列積 AB

となり、

一方で、

であり、成分は内積の総和として現れる。したがって

行列積は一般に可換ではなく、

結合則

ブロック行列としての理解も重要である。例えば特徴を群に分けたとき、行列積はブロックごとの相互作用を持ち、同じ式でも構造が見えると解釈や近似が容易になる。

1.3 4つの基本部分空間

行列

階数を

である。特に

直交分解として

が成り立つ。ここで

最小二乗

となるが、これは

この4空間は、データの冗長性や同定不能性を表す。例えば特徴量が線形従属であると

1.4 消去と A = LU

ガウス消去は、行基本変形により

が得られ、

実際には、ピボットが0または非常に小さいと不安定になるため、行の入れ替えを行うことが多い。このとき

という形で置換行列

行列式とも関係し、

である。

消去は線形代数の「計算の骨格」を与えるが、同時に数値誤差の入り口でもある。したがって、分解の存在だけでなく、ピボット選択と条件数の理解が不可欠である。

1.5 直交行列と部分空間

直交行列

直交基底は射影を簡潔にする。

である。任意の

直交化の基本手続きとしてグラム・シュミット法がある。線形独立な

部分空間の言葉で見ると、

1.6 固有値と固有ベクトル

もし

と書ける。このとき

となり、長時間挙動は

固有値は安定性とも関係する。離散時間系

対称行列では性質が大きく良くなる。

となる。この直交性により、固有分解は数値的にも幾何的にも扱いやすい。

データ解析では、共分散行列の固有値が分散の大きさを表し、グラフラプラシアンの小固有値が連結性やクラスタ構造を表す。固有問題は「データの長期的・大域的な形」を抽出する道具として働くのである。

1.7 正定値対称行列

対称行列

が成り立つことである。このとき固有値はすべて正であり、二次形式

正定値性は内積を定める。

は内積になり、

数値計算ではコレスキー分解

が重要である。

反復法の立場では、共役勾配法は正定値対称系

統計では共分散行列が半正定値である。データが十分に独立で分散が正なら正定値に近づき、逆行列(精度行列)が意味を持つ。逆行列は部分相関や線形予測に現れ、線形代数が確率の構造へ踏み込む入り口となる。

1.8 特異値分解による特異値と特異ベクトル

任意の

を持つ。

特異値分解は、対称固有分解と密接に関係する。実際に

となり、

幾何的には、

逆問題では擬似逆行列が重要になる。

であり、最小二乗解の一つを与える。小さい特異値は

特異値分解は階数と4つの基本部分空間を同時に可視化する。右特異ベクトルのうち

1.9 主成分と最適な低ランク行列

データ行列を

であり、

SVDで見ると

低ランク近似は、データの自由度を減らしても情報を保つために用いられる。切断SVDにより

とすると、Eckart–Youngの定理により

を最小にする。これは「最も誤差が小さい圧縮」が数学的に一意に決まることを意味する。

PCAの目的は「分散を最大にする方向」を選ぶことであり、低ランク近似の目的は「再構成誤差を最小にする」ことであるが、中心化と二乗誤差の下では両者が一致する。したがって、分散の説明率と再構成誤差の両方が同じ固有値・特異値により測れる。

注意すべき点として、中心化を行わないと主成分が平均方向に引かれやすい。さらに特徴量の単位が大きく異なると、分散の大きい特徴が主成分を支配しやすく、標準化や相関ベースの扱いが必要になる場合がある。

1.10 レイリー商と一般化固有値

対称行列

で定義され、

極値は固有値に一致する。すなわち

であり、最大値・最小値を与える

一般化固有値問題は

であり、

に置き換わり、

この形式は、重み付き最小二乗や正則化の背後に現れる。例えば「あるエネルギーを小さくしつつ別の量を固定する」型の設計では、自然に

1.11 ベクトル,関数,行列のノルム

ベクトルノルムには

である。これらは誤差の測り方を変える操作であり、損失関数や正則化項の形を決める。

関数ノルムは連続版として現れる。例えば区間上の関数

はエネルギーを測る量であり、フーリエ解析や最小二乗近似の理論で重要である。

行列ノルムは作用素ノルム(誘導ノルム)として

で定義される。

が成り立つ。

フロベニウスノルム

も頻繁に用いられる。

ノルムには基本的不等式があり、例えば誘導ノルムでは劣乗法性

が成り立つ。これにより、複数段の変換が誤差をどれだけ増幅し得るかを上から押さえることができる。

条件数はノルムで定義される。可逆行列

であり、

1.12 行列とテンソルの分解:非負と疎

非負値行列分解(NMF)は、非負データ

を求める。非負制約により、正負の相殺が起きにくく、加法的な部品表現として解釈しやすいことが多い。

NMFは一般に非凸であり、初期値や更新則に依存して異なる解へ到達し得る。したがって、解の一意性よりも、目的に合った表現(例えば局在性や滑らかさ)を得るための制約設計が重要である。

疎表現は、多くの成分が0に近い係数でデータを表すことを目指す。辞書

を解くと、

行列分解ではランクが構造仮定であるのに対し、疎表現では「成分数の少なさ」が構造仮定である。両者は別の仮定であるが、同時に用いることで「低ランクかつ疎」といった複合的な表現も設計できる。

テンソル分解は多次元配列

の形でランク1テンソルの和として表し、Tucker分解は

の形でコアテンソル

テンソルでは、行列とは異なる同定性の性質が現れる。条件が整うと、回転の自由度が少なく、因子が比較的決まりやすい場合がある一方、計算は非凸で大規模化しやすい。したがって、分解の目的(圧縮、解釈、予測)に応じてランクや制約を設計する必要がある。

本章の要点は、行列の作用を列空間として捉え、直交性で誤差を分解し、分解(LU・QR・固有分解・SVD)で構造を抽出することである。これらは次章以降の大規模計算や学習法の式変形で繰り返し用いられ、同じ概念が異なる形で再登場するのである。

第2章:大規模行列の計算

本章では、行列のサイズが大きくなったときに何が難しくなり、どの数学的工夫が計算を成立させるかを整理するのである。密行列の分解をそのまま適用できない状況を前提に、誤差の評価、最小二乗の解法の分岐、基底の取り方、乱択法による近似という流れで述べるのである。

2.1 数値線形代数

数値線形代数は、有限精度の浮動小数点計算で線形代数を実行するとき、結果がどの程度信頼できるかを定量化し、安定に計算する方法を与える分野である。理論上同じ式であっても、計算の順序や分解法の選択により、誤差の増幅が大きく異なるのである。

浮動小数点では、四則演算の結果は一般に丸めを受ける。典型的には

のようにモデル化され、

誤差評価では、前進誤差と後退誤差を区別する。前進誤差は得られた解

線形方程式

と定めると、

大規模行列では、メモリと計算量の制約が最初に効いてくる。密な

疎行列は非零要素数

代表的な反復法として、Krylov部分空間法がある。初期残差

を構成し、その部分空間上で最も良い近似解を求めるのが基本原理である。共役勾配法は対称正定値系に適合し、GMRESは一般の非対称系へ拡張される。

反復法の性能は前処理に大きく依存する。前処理は、元の問題

停止条件も数値線形代数の中心である。反復を止める基準として

2.2 最小二乗法の4つの方法

最小二乗問題は

であり、データサイエンスでは回帰、同定、復元の最も基本的な形である。幾何学的には、

最適性条件は残差

すなわち正規方程式

が得られる。この式は簡潔であるが、数値的には

最小二乗の主要な解法は、正規方程式、QR分解、SVD、反復法の4つとして整理できる。いずれも同じ幾何を異なる分解で実装しているが、計算量・安定性・拡張性が異なるのである。

| 方法 | 主要変形 | 数値安定性 | 計算量の目安(密行列) | 備考 |

|---|---|---|---|---|

| 正規方程式 | 低い場合がある | 条件数が悪化しやすい | ||

| QR分解 | 高い | 直交性で誤差が抑えられる | ||

| SVD | 最も高い | ランク欠損・正則化と整合 | ||

| 反復法 | 行列ベクトル積 | 前処理次第 | 巨大・疎で有効 |

正規方程式は、実装が簡単で計算資源が限られる場合に魅力があるが、

QR分解は、直交行列

であり、

SVDは最小二乗を最も透明にする。

で与えられる。小特異値がノイズを増幅する機構が式の形で現れるため、正則化を入れた議論と整合しやすいのである。

正則化付き最小二乗として、Tikhonov正則化(リッジ回帰)がある。これは

であり、正規方程式は

となる。

重み付き最小二乗も重要である。誤差の共分散が

となり、

反復法は、

最小二乗の幾何をもう一段掘り下げると、射影行列が現れる。列が一次独立であるとき、最小二乗解は

であり、近似値は

で

2.3 列空間の3種類の基底

列空間

第1の基底は、元の列ベクトルの部分集合として選ぶ基底である。ガウス消去やピボット付きQRにより、独立性の高い列を選択し、それらで列空間を張る。元の特徴量の一部として基底が表現されるため、解釈が直感的であり、どの特徴が空間を支配しているかが見えやすいのである。

この考えは列サブセット選択(CUR分解など)へもつながる。

第2の基底は直交基底である。QR分解

直交基底の重要性は、誤差解析でも現れる。直交変換はノルムを保存するため、

第3の基底は特異ベクトル基底である。SVD

特異ベクトル基底は低ランク近似へ直結する。上位

3種類の基底は互いに排他的ではなく、目的によって併用される。解釈を保ちたいときは列選択基底が有利であり、安定な計算を優先するときは直交基底が有利であり、圧縮やノイズ除去を重視するときは特異ベクトル基底が有利である。したがって「どの基底が良いか」は、行列の性質だけでなく、取り出したい情報の種類に依存するのである。

2.4 乱択線形代数

乱択線形代数は、ランダム性を用いて行列の主要構造を高速に近似する方法を体系化した分野である。巨大データでは厳密分解にこだわるよりも、高い確率で十分良い近似を短時間で得ることに価値があり、乱択法はその要求に合致するのである。

基本となる発想はスケッチである。行列

を作り、小さい問題で近似解を得る。

距離保存の背後にはランダム射影の理論がある。高次元点集合の距離をほぼ保ったまま低次元へ写せるという事実は、スケッチが幾何を壊しにくい理由を与える。したがって乱択法は、単なる経験的技巧ではなく、確率的な保証を伴う近似である点が重要である。

乱択SVD(乱択低ランク近似)の基本形は、行列の値域をランダムに探索することである。ランダム行列

を作ると、

次に、

である。これにより大行列

特異値の減衰が遅い場合には、パワー反復を組み合わせる。例えば

とすると、支配的特異値の寄与が強調され、近似が改善される。これは「重要方向をより見つけやすくする」操作であるが、反復回数

スケッチ行列

乱択法は最小二乗にも直接適用できる。スケッチ後の問題

を解くと、元の問題の近似解が得られ、特に

列・行のサンプリングという考え方も重要である。行列の情報は均一に分布しているとは限らず、少数の行や列が大きな影響力を持つことがある。レバレッジスコアはその影響度を測る量であり、これに比例してサンプルすると近似が良くなるという思想が生まれるのである。

乱択線形代数の価値は、計算の高速化だけではない。大規模データでは、厳密解が必ずしも最良の推定を意味しないことが多く、近似が統計的安定性と親和的である場合もある。したがって、乱択法は「計算資源の制約下で、構造を保った近似を得る」ための数学として位置づけられるのである。

本章で述べた数値線形代数、最小二乗の複数解法、基底の取り方、乱択近似は、いずれも行列の分解と直交性という第1章の概念を計算へ翻訳したものである。次章以降では、低ランクや疎性といった構造仮定が、どのように推定可能性と計算可能性を同時に成立させるかを、さらに深い形で扱うのである。

第3章:低ランク行列と圧縮センシング

本章では、低ランク性と疎性という2つの構造が、少ない情報からの復元やノイズ分離を可能にする理由を、逆行列の更新・固有値の挙動・特異値の減衰という線形代数の言葉で説明するのである。さらに、

3.1 A の変化から生じる A^{-1} の変化

逆行列は、行列のわずかな変化に対して大きく変動し得る量であり、その感度は条件数と密接に関係する。大規模計算や逐次推定では、

基本となる事実は、可逆行列

を考えるとき、

が成り立つことである。分母の

より一般に、低ランク更新

に対しては Woodbury の公式

が成り立つ。

これらの公式は、逆行列そのものを持たなくても意味を持つ。実際には

微分の観点からも、逆行列の感度は簡潔に表せる。

が成り立ち、一次の変化は

低ランク更新は、正則化とも結びつく。例えばリッジ型の更新として

3.2 インターレースする固有値と低ランクな信号

低ランクな変更は、固有値の分布を局所的に動かすが、その動きには厳密な制約がある。特に対称行列に対する固有値のインターレースは、低ランク信号がノイズの上に突き出す条件を、固有値列の順序として記述する道具となるのである。

まず、対称行列

と並べる。

が成り立つ。部分系の固有値が元の固有値の隙間に挟まるという事実は、データの一部欠落やサブサンプリングがスペクトルへ与える影響の限界を与えるのである。

rank-1 更新

を与え、低ランクであっても

低ランク信号の基本モデルとして、スパイク型の共分散を考える。真の共分散を

とすると、

この分離は、固有値の間隔と固有ベクトルの安定性にも直結する。Davis–Kahan 型の評価により、固有値ギャップが大きいほど固有ベクトルは摂動に強く、ギャップが小さいほど方向は回転しやすい。したがって、低ランク信号をスペクトルで検出する議論では、固有値そのものだけでなく、固有値の間隔を同時に扱う必要があるのである。

グラフラプラシアン

3.3 急速に減衰する特異値

多くの実データでは、行列の特異値が急速に減衰し、有効な自由度が小さいことが多い。これはデータが本当に低ランクである場合だけでなく、低ランク近似が少ない誤差で成り立つという意味で「低ランクに近い」状況が広く存在するためである。

が成り立つ。ゆえに、特異値が速く落ちるほど、少数の成分で行列を高精度に表現できるのである。

特異値減衰の形は、近似の難易度を決める。指数的減衰

統計の観点では、特異値の小さい方向はノイズに埋もれやすい。

この事情は、切断が推定の安定化として働く理由でもある。小特異値の逆数は擬似逆で増幅因子になるため、切断SVDは不安定な方向を捨てることで推定誤差を抑える。したがって低ランク近似は、圧縮だけでなく、逆問題の安定化としても理解されるのである。

特異値減衰は計算方法にも影響する。上位

3.4

基本形は LASSO に代表される

である。

この問題は凸であり、近接勾配法で解ける。

であり、更新は

の形になる。ここで

収束を速める方法として加速近接勾配(FISTA)があり、同じ近接写像を用いながら、補助変数を導入して収束率を改善する。凸性の下で収束保証が明確である点は、大規模データで反復回数を見積もる上で意味が大きいのである。

と分解し、

で定式化される。ここで

核ノルムの近接写像は特異値しきい値(SVT)である。

となり、特異値をソフトに削る操作として低ランク化が実現される。疎成分の更新がソフトしきい値であるのと並行しており、低ランクと疎の分離が同じ数学構造の上で進むことが見えるのである。

実装上は ADMM による分割がよく用いられる。制約

のような緩和が自然であり、データの不確かさを許容した推定になる。制約型と罰則型は双対性を通じて関係するが、

次の表は、

| 目的 | 代表的定式化 | 構造仮定 | 主要近接写像 |

|---|---|---|---|

| 疎回帰 | ソフトしきい値 | ||

| 疎復元(制約型) | 射影としきい値 | ||

| 低ランク近似 | SVT | ||

| 低ランク+疎分離 | SVT とソフトしきい値 |

3.5 圧縮センシングと行列補完

圧縮センシングは、未知ベクトルが疎であるという仮定の下で、観測数が未知数より少ない状況から復元を可能にする理論である。行列補完は、未知行列が低ランクであるという仮定の下で、観測エントリが欠けた状況から全体を復元する理論であり、疎性と低ランク性が互いに鏡像のような位置にあることを示すのである。

圧縮センシングの基本式は

であり、未知

理想的な定式化は

(ノイズがある場合は

観測行列

が成り立つなら、

復元アルゴリズムには、基底追跡(

行列補完は、部分観測から低ランク行列

と定めると、基本形は

を満たす低ランク

が中心となる。核ノルムがランクの凸包として働き、低ランク性を促すのである。

行列補完が可能であるためには、低ランクであるだけでは不十分であり、非ゼロ成分が特定の行や列に偏りすぎないことが必要である。これは非整合性(incoherence)として定式化され、特異ベクトルが標準基底へ極端に集中しないことを要求する。直感的には、情報が全体に分散しているほど、ランダムに欠けても埋め戻しが可能になりやすいのである。

ノイズがある場合には

のような罰則型が自然である。近接勾配法では、観測誤差に対する勾配ステップと、SVTによる核ノルム近接が交互に現れ、低ランク性を維持しながら観測へ合わせていく形になるのである。

圧縮センシングと行列補完は、未知量の構造が異なるだけで、数学的骨格は共通である。疎性は座標基底での少数成分、低ランク性は特異ベクトル基底での少数成分という形で表現され、どちらも

本章では、低ランク更新が逆行列や固有値に与える制約、特異値減衰が近似と安定性を同時に支える理由、そして

第4章:特別な行列

本章では、信号処理・画像処理・ネットワーク解析・クラスタリングなどで頻出する行列構造を取り上げ、その構造が計算と理論の双方を簡単にする理由を線形代数として述べるのである。これらの行列は、対角化や低ランク近似、反復法の高速化へ自然に接続し、データ解析の中核的な演算を支えるのである。

4.1 フーリエ変換:離散と連続

連続フーリエ変換は

で定義され、時間(あるいは空間)領域の関数を周波数領域へ写す線形変換である。逆変換は規約に依存する定数を除いて

の形で与えられ、フーリエ変換は情報を失わない可逆な表現変換である。

フーリエ変換が重要なのは、微分や畳み込みが周波数領域で単純化されるためである。例えば

と定めると、畳み込み定理により

が成り立つ。これは線形時不変系(シフト不変な系)の解析が、周波数成分ごとのスカラー倍へ還元されることを意味するのである。

エネルギー保存を述べる Parseval の等式も基本である。規約に応じた係数は変わるが、一般に

が成り立ち、時間領域の二乗和と周波数領域の二乗和が同じ情報量を持つことを示す。したがってノイズの大きさやフィルタの影響が、ノルムとして一貫した形で評価できるのである。

離散フーリエ変換(DFT)は

で与えられる。逆DFTは

であり、DFTは可逆な線形変換である。

DFTは行列

とすると、規格化した行列

FFTはDFTを高速に計算するアルゴリズムであり、計算量を

連続と離散の接続では、標本化と周期延長が本質である。DFTは有限長列を周期的に延長した信号の周波数成分を与え、畳み込みは巡回畳み込みとして現れる。したがって、有限長データの畳み込みやフィルタリングをDFTで扱うとき、線形畳み込みと巡回畳み込みの差を埋めるためにゼロ埋めが必要になるのである。

次の表は、変換の対象と計算構造の差を整理したものである。

| 対象 | 変換 | 演算としての姿 | 主な帰結 |

|---|---|---|---|

| 連続関数 | 積分 | 作用素 | 微分・畳み込みの単純化、スペクトル解析 |

| 離散列 | 行列(和) | ユニタリ変換 | 周期構造、巡回行列の対角化、FFTによる高速化 |

4.2 巡回置換行列と巡回行列

巡回置換行列

とすると、

巡回行列

のように多項式で表せる。よって巡回行列の積は、巡回シフトの線形結合として理解できるのである。

巡回行列が特に扱いやすいのは、DFTで対角化できるためである。フーリエ行列

となり、

となり、巡回行列の作用は周波数領域で成分ごとのスカラー倍に還元される。

この構造は、巡回畳み込みが周波数領域で積になる事実と同値である。信号

となる(

巡回行列は数値線形代数にも現れる。例えばテプリッツ行列を巡回行列で近似すると、前処理や近似解法が高速化されることがある。巡回構造は境界条件が周期的である状況に自然であり、周期境界を仮定した差分法やスペクトル法とも整合するのである。

4.3 クロネッカー積 A×B

クロネッカー積は通常

で定義される。テンソル積に対応し、多次元格子や多因子モデルの演算を、行列として一貫して表す道具である。

クロネッカー積の重要性は、次元分離(separable structure)を保ったまま多次元化できる点にある。例えば2次元画像に1次元作用素を縦方向・横方向へ別々に作用させる操作は、クロネッカー積で簡潔に書ける。これにより、巨大な

基本恒等式として、行列のベクトル化

が成り立つ。これは、多次元配列上の双線形作用が、クロネッカー積の一次作用へ落ちることを意味する。したがって回帰やテンソル推定の式変形で、設計行列がクロネッカー積として現れることが多いのである。

固有値・特異値にも保存則がある。

計算面では、

4.4 クロネッカー和による正弦変換と余弦変換

クロネッカー和は

で定義される。特に2次元ラプラシアンの差分離散化は、1次元差分作用素のクロネッカー和で表され、分離可能な構造を保つ。よって多次元偏微分方程式の離散化が、1次元問題の積み重ねとして扱えるのである。

例えば1次元の2階差分作用素を

とすると、2次元格子上のラプラシアンに対応する行列は

となる。これにより、2次元の巨大系の固有値・固有ベクトルが、1次元の固有対から構成できるという利点が生まれるのである。

固有分解の保存則として、

となる。つまりクロネッカー和の固有値は和になり、固有ベクトルはテンソル積になる。したがって多次元のスペクトルが直積構造として整理でき、分離可能な高速解法が組み立てられるのである。

境界条件を含めると、固有基底として離散正弦変換(DST)や離散余弦変換(DCT)が自然に現れる。ディリクレ境界(端で値が0)に整合する基底が正弦になり、ノイマン境界(端で微分が0)に整合する基底が余弦になる。よって、対応する変換を用いることで差分作用素が(同値な意味で)対角化され、線形方程式の解が周波数ごとの割り算へ還元されるのである。

次の表は、境界条件と基底の対応を整理したものである(実装の細部は規約で変化し得るが、対応の方向性は変わらない)。

| 境界条件(1次元) | 固有基底の形 | 代表的変換 |

|---|---|---|

| ディリクレ(端で0) | 正弦 | DST |

| ノイマン(端の勾配0) | 余弦 | DCT |

| 周期 | 複素指数 | DFT |

画像圧縮でDCTが重要なのは、自然画像が低周波成分へエネルギーが集中しやすいことと、ブロック単位の境界条件が余弦基底と整合しやすいことに由来する。偏微分方程式のソルバでDST/DCTが重要なのは、境界条件を満たす固有基底に展開することで、作用素の逆を周波数領域で実行できるからである。

4.5 テプリッツ行列とシフト不変フィルタ

テプリッツ行列は、対角方向に一定な成分を持つ行列であり、

の形で表される。これは有限長の線形畳み込み(端では外側が0とみなされる状況)を行列積として表現したものであり、シフト不変フィルタが境界で破れることを行列構造として反映するのである。

長さ

巨大なテプリッツ系

また、自己相関や共分散推定ではテプリッツ構造が自然に現れる。弱定常過程では自己共分散がラグ差にのみ依存するため、共分散行列がテプリッツになる。ゆえに時系列の推定や予測は、テプリッツ構造を保った最小二乗や正則化として組み立てられるのである。

テプリッツと巡回の差は、境界の扱いに集約される。信号が周期であると仮定すれば巡回行列が正確なモデルになり、そうでなければテプリッツが自然である。よって、問題の物理やデータ生成過程に即した境界条件を選ぶことが、行列構造の選択に相当するのである。

4.6 グラフとラプラシアンとキルヒホッフの法則

重み付き無向グラフ

で定めると、グラフラプラシアンは

である。

二次形式は

となり、隣接ノード間の差の二乗和として解釈される。よって

正規化ラプラシアンも重要である。対称正規化は

であり、ランダムウォーク正規化は

である。次数のばらつきが大きいグラフでは、正規化によりクラスタリングや拡散の性質が安定しやすくなる。

ラプラシアンは incidence 行列(接続行列)で表現できる。向きを付けた辺集合に対し incidence 行列

(

電気回路との対応では、ノード電位

で結ばれる。これはキルヒホッフの電流則(各ノードで流入出の和が0)とオーム則(電位差に比例して電流が流れる)をまとめた線形方程式であり、ネットワーク問題がラプラシアン系へ帰着することを示す。

ラプラシアンの零固有値は連結成分の数を与える。具体的には、無向グラフが

行列木定理は、

4.7 スペクトラル法と k 平均法によるクラスタリング

スペクトラルクラスタリングは、データ点をノードとし、類似度から重み付きグラフを作り、ラプラシアンの固有ベクトルで埋め込みを作った上で

基本的な構成は次の通りである。まず類似度

や

理論的には、グラフカットの最適化が固有問題へ緩和される。例えば正規化カット(Normalized Cut)は、離散的な割当て変数の組合せ最適化であるが、連続緩和を行うとラプラシアンの固有ベクトルが最適解の候補になる。したがって固有ベクトルは、分割問題を凸に近い形へ移した結果として現れるのである。

正規化の選択も数学的意味を持つ。

大規模データでは固有ベクトル計算が支配的になるため、第2章の反復法や乱択法が重要になる。特に上位ではなく下位固有ベクトルが必要である点が特徴であり、シフト付き反復やLanczos法、前処理などが効果を持つ。類似度行列を疎に構成することも、計算量と記憶量を決める要因になるのである。

4.8 ランク1 行列の補完

ランク1行列は

の形で表され、最も単純な低ランク構造である。観測が欠けた状況で

観測集合

である。これは未知が

同定可能性は、

推定は非凸になりやすい。最小二乗で

と書くと、

ノイズを含む場合には正則化が有効である。例えば

はスケールの暴れを抑え、推定の安定性を改善する。これは核ノルム正則化と深い関係を持ち、一般の低ランク補完にも同型の設計が拡張されるのである。

ランク1は単純であるが、欠損が偏ると推定が急に不安定になる。ある行や列がほとんど観測されない場合、その成分は他から拘束されず推定誤差が大きくなる。よって観測の配置が、ランクそのものと同程度に復元の難易度を支配するのである。

4.9 直交プロクラステス問題

直交プロクラステス問題は、行列

を解く問題である。

解はSVDで与えられる。

が最適解である。これは

回転のみ(反射を除く)を要求する場合は

平行移動も含める場合は、点の重心を引いてから直交プロクラステスを適用するのが基本である。すなわち列平均を引いた

データサイエンスでは、埋め込み表現の整列に現れる。例えば異なる学習で得た特徴空間が、同じ意味構造を持ちながら回転している場合、プロクラステスにより空間を合わせて比較できる。SVDが幾何的整合を直接与える点で、分解と解釈が結び付いた代表例である。

4.10 距離行列

距離行列は点集合

または二乗距離

を並べた行列である。距離は幾何を直接に表し、クラスタリング、可視化、カーネル法など多くの手法の入力として用いられるのである。

二乗距離行列と内積行列(グラム行列)の相互変換が基本である。点を行列

が成り立つ。よって距離が分かれば内積が復元でき、内積が分かれば距離が復元できるのである。

多次元尺度構成法(MDS)はこの関係を用いる。中心化行列

を用いると、二乗距離行列

で得られる。

距離行列がユークリッド距離として整合するためには条件がある。中心化後の

距離と内積の変換はカーネル法にも直結する。カーネル行列

距離行列はグラフにも接続する。例えば最短路距離から距離行列を作ると、グラフ上の幾何を連続空間へ埋め込む議論が可能になる。さらに有効抵抗距離はラプラシアンの擬似逆

と書け、スペクトルと距離が同じ式で結ばれるのである。

本章では、フーリエ・巡回・クロネッカー・テプリッツ・ラプラシアン・距離行列など、構造が明確な行列が持つ対角化・分離・低ランク性の性質を、計算可能性と解釈可能性の双方から述べたのである。次章では、これらの行列が確率・統計の中でどのように現れ、平均・分散・共分散・多変量分布が線形代数として統一的に書けることを扱うのである。

第5章:確率と統計

本章では、確率変数と分布を言葉ではなく数式で扱うための基礎を、平均・分散から多変量分布とマルコフ連鎖まで一貫して述べるのである。線形代数で現れた内積・ノルム・固有値は、共分散行列や二次形式として確率論の中心に現れ、推定と学習の理屈を支えるのである。

5.1 平均と分散と確率

確率論の出発点は確率空間

確率変数

で定義される。離散の場合は

分散は

であり、不確かさの大きさを二乗平均として表す。計算上は

が頻用され、平均と2次モーメントが分かれば分散が求まるのである。標準偏差

期待値の基本性質として線形性

が成り立つ。分散は線形ではないが、独立であれば加法性

が成り立つ。独立性がない場合は共分散が現れ、

となるのである。

確率の基本操作として、条件付き確率と全確率の公式がある。

であり、分割

が成り立つ。これらは推定や分類で現れる事後確率の計算を支えるのである。

統計に入ると、母数と標本の区別が重要になる。独立同分布(i.i.d.)の標本

は母平均

分散の推定では自由度補正が現れる。母分散を

は

平均のゆらぎは中心極限定理で与えられる。十分な条件の下で

が成り立ち、

5.2 確率分布

分布は確率変数の生成法を数式で表したものであり、尤度や損失関数の形を通じて推定と学習の骨格を決める。離散分布は確率質量関数

を満たすのである。

基本となる離散分布としてベルヌーイ分布は

であり、二項分布は独立なベルヌーイ試行の和として

で与えられる。ポアソン分布は希な事象の回数として

であり、二項分布の極限として現れるのである。

連続分布の中心は正規分布である。

であり、加法ノイズや誤差のモデルとして頻用される。指数分布は待ち時間として

を持ち、無記憶性

分布は推定の式を通じて具体化される。観測データ

であり、最大化する

を最大化する形に直すのが自然であり、積が和へ変換されることで最適化が容易になるのである。

分布選択は、負の対数尤度が誘導する損失関数を通じて直接に現れる。代表例を次の表にまとめるのである(定数項は省略する)。

| 観測モデル | 条件付き分布 | 負の対数尤度(1点) | 推定で現れる量 |

|---|---|---|---|

| 実数値+ガウスノイズ | 二乗誤差( | ||

| 実数値+ラプラスノイズ | $\propto e^{- | y-f | /b}$ |

| 二値分類 | 交差エントロピー | ||

| カウント | ログリンクと整合 |

この対応により、損失関数の形を恣意的に選ぶのではなく、ノイズや生成仮定として説明できるようになる。外れ値が多いと二乗誤差は大きく引きずられるが、ラプラス型は外れ値に対して感度が相対的に抑えられるため、分布仮定が推定の頑健性へそのまま反映されるのである。

さらに一般化すると、指数型分布族

が現れる。ベルヌーイ、ポアソン、正規(分散既知)などが含まれ、十分統計量

5.3 モーメントとキュムラントと統計の不等式

モーメントは分布の形を数で特徴づける。

確率母関数としてモーメント母関数

がある。

を導入すると、その係数がキュムラントになる。キュムラントが重要なのは独立和に対して加法的である点であり、独立な

が成り立つ。よって和の分布の近似や漸近評価が扱いやすくなるのである。

推定や学習では、確率的な偏差を制御する不等式が要になる。最も基本のマルコフ不等式は非負確率変数

である。これを

が得られ、分散のみから尾確率を上界できるのである。

独立な有界変数の平均の集中にはヘフディング不等式が現れる。

となり、平均の偏差が指数的に小さくなることを示す。より精密には分散も使うベルンシュタイン型の不等式があり、尾の形状が改善されるのである。

確率論で頻出する単純な評価として和の評価(合併界)

がある。多数の誤差事象を一括して抑えるときに用いられ、高次元統計で座標ごとの偏差を同時に抑える議論へ接続するのである。

これらの不等式は、乱択線形代数やランダム行列にも現れる。例えばランダムな射影でノルムが保たれるという主張は、確率的集中を用いて「ほとんど確実に」歪みが小さいことを示す形で支えられる。線形代数で扱ったノルムやスペクトル半径が、確率の上界にそのまま現れる点が重要である。

5.4 共分散行列と同時確率

多変量確率変数

で定義される。

が成り立つため半正定値である。よって共分散行列は、線形結合の分散を与える行列として理解できるのである。

であり、相関係数は

で規格化される。相関が0でも独立とは限らないが、正規分布では相関0が独立性と一致するという特別な性質があるのである。

標本からの推定では、データ行列

で与えられる。これはグラム行列の形であり、線形代数の視点では

同時確率(結合分布)

と分解でき、ベイズ則

が推論を与える。推定での事前分布

依存構造を疎にする考え方として条件付き独立がある。例えば確率変数の集合で、ある変数を条件にすると他が独立になる構造は、グラフとして表現できる。ガウス型の場合、精度行列

の非ゼロパターンが条件付き独立性に対応し、

共分散行列はスケーリングの影響を強く受けるため、標準化(白色化)が重要になることがある。白色化は

5.5 多変量正規分布と重み付き最小二乗法

多変量正規分布

で与えられる。指数部に現れる

はマハラノビス距離の二乗であり、

多変量正規の重要な性質として、線形変換で閉じることがある。

である。したがって線形観測モデルの誤差伝播が明示的に追える。周辺分布(部分変数の分布)も正規であり、条件付き分布も正規になるため、推定が解析的に扱いやすいのである。

線形モデル

に一致し、これは重み付き最小二乗(一般化最小二乗)である。

この最小化の一階条件は正規方程式

である。

計算上は前処理(白色化)が有効である。

となる。よって

と置けば、問題は通常の最小二乗

へ還元される。これは「相関のある誤差を、変換で無相関にする」という意味であり、線形代数として明快である。

さらに事前分布を入れるとMAP推定が現れる。例えば

となり、二次の正則化(リッジ型)を得る。ここでも正定値行列が内積を定め、推定が幾何として理解できるのである。

5.6 マルコフ連鎖

マルコフ連鎖は、状態

で表される。

を満たす。時間発展は分布ベクトル

と書け、確率過程が線形代数の反復として表現されるのである。

定常分布

を満たす分布であり、固有値1に対応する左固有ベクトルである。連鎖が既約(どの状態からも他へ到達可能)かつ非周期であれば、初期分布に依らず

収束の速さはスペクトルで特徴づけられる。

グラフ上のランダムウォークは特に重要である。重み付きグラフで

を用いると、

可逆性(詳細釣り合い)も中心概念である。ある分布

が成り立つとき、連鎖は

マルコフ連鎖は推定や学習の計算にも現れる。反復による期待値評価、サンプリングに基づく近似、拡散としての平滑化などであり、行列の反復と確率の反復が同じ数式で記述できる点が重要である。したがって確率モデルを立てることは、同時に計算可能な反復構造を設計することでもあるのである。

本章では、期待値と分散から始めて、分布の選択が尤度と損失を決める流れ、共分散行列が線形代数として推定を統一する流れ、さらにマルコフ連鎖が反復行列として解析できることを示したのである。次章では、これらの推定や学習で現れた目的関数をどのように最小化するかを、凸性・双対性・勾配法の言葉で整理し、計算手順へ落とし込むのである。

第6章:最適化

本章では、推定や学習で現れる目的関数を最小化するための数学を、凸性・制約・双対性・反復法として整理するのである。線形代数で扱った正定値性、確率統計で現れた最尤推定や正則化が、最適化の言葉で統一され、計算手続きへ直結するのである。

6.1 最小化問題:凸性とニュートン法

最適化の基本形は

である。

凸性は局所情報から大域結論を得るための条件である。集合

が成り立つことである。凸であれば局所最小は大域最小であり、複雑な関数でも最小値の取り違えが起きないという強い性質を持つのである。

滑らかな凸関数には一次の特徴づけがある。

が任意の

二次関数は最適化の基準系である。

を最小化すると、最適性条件は

となり、正定値一次方程式に帰着する。したがって最適化の反復は、線形代数の反復解法(共役勾配法など)と同じ構造を持つのである。

ニュートン法は局所2次近似に基づく反復である。

を最小化すると、ニュートン方向

の解として得られ、更新は

となる。最小化そのものが「毎回、正定値系を解く」問題へ落ちる点が本質である。

ニュートン法は適切な条件下で局所二次収束を示す。最適解の近傍でヘッセ行列が非特異かつ十分滑らかであれば、誤差が二乗で縮むため反復回数が少なくて済む。しかし、ヘッセ行列が不定(鞍点近傍)であったり、遠方では2次近似が悪かったりすると発散も起こり得る。そこで実用では、直線探索によりステップ長

とするのである。

ヘッセ行列の解法が計算を支配するため、ニュートン法は数値線形代数と不可分である。大規模問題では

凸性の二次条件も重要である。

と同値である。強凸性はさらに

を満たすことであり、最小解の一意性と勾配法の収束率を与えるのである。

6.2 ラグランジュ乗数= コストの導関数

制約付き最適化の基本形は

である。制約があると、勾配ゼロだけでは解を特徴づけられない。ラグランジアン

を導入し、停留条件

で解を特徴づけるのである。

幾何学的には、制約面

となり、

ラグランジュ乗数の解釈は感度である。制約を

として現れる(符号は定式化に依る)。したがって

不等式制約

を含めると、KKT条件が中心になる。ラグランジアンを

とし、条件は

である。最後の相補性条件は、制約が効いていないときは乗数が0になることを示し、活性制約だけが最適性に関与するという意味を持つのである。

二次目的と線形制約は特に重要である。例えば

では、KKT条件はブロック行列の一次方程式になる。

よって制約付き最小化は、対称だが不定な線形系を解く問題へ帰着する。ここでの数値的難しさ(条件数、前処理、疎性の利用)が計算の成否を決めるのである。

正則化は制約の別表現でもある。例えば

6.3 線形計画法,ゲーム理論,双対性

線形計画(LP)は

の形で表される。目的も制約も線形であるため、可行集合は多面体になり、最適解は多面体の頂点に存在する。よって最適化が組合せ的な構造を持つが、双対性により解析が非常に強力になるのである。

このLPの双対は

である。弱双対性として、任意の可行解

が成り立つ。したがって双対可行解は目的値の下界(最小化の場合)を与え、解の良さを証明する手段になるのである。

強双対性は条件の下で最適値が一致することを述べる。LPでは可行性が満たされれば一般に強双対性が成立し、最適解

となる。さらに相補性条件

が成り立ち、どの制約が効いているかが構造として読み取れるのである。

双対性は感度解析にも直結する。

ゲーム理論のゼロ和ゲームはLPとして書ける。利得行列

が成立し、この値の計算はLPへ落ちる。混合戦略は確率ベクトルであるため、制約が線形で保たれるのである。

データサイエンスでは、双対はアルゴリズム設計の別表現を与える。支持ベクトル機械(SVM)は、マージン最大化の primal と、内積(カーネル)だけで表される dual の形を持つ。輸送問題や最適輸送でも、dual がポテンシャル関数として現れ、計算と解釈の中心になるのである。

双対ギャップ

は最適性の証明に使える。反復法で primal と dual の可行解を同時に更新できれば、この差が0へ近づくことを停止判定にできる。これは数値計算の誤差評価を理屈で支える重要な仕組みである。

6.4 最小へ向かって進む勾配降下法

勾配降下法(GD)は

で更新する。ここで

勾配が最急降下方向であることは内積に依存する。ユークリッド内積

を最も減らす単位ベクトルは

解析の中心は滑らかさである。

である。このとき

が成り立ち、

強凸性を仮定すると収束率が評価できる。

のような線形収束が得られる。比

二次関数での挙動は明瞭である。

という線形反復になる。固有分解

前処理は内積を変える操作である。正定値行列

とすると、

座標降下法も同じ枠内にある。成分ごとに更新する方法は、疎なモデル(

6.5 確率的勾配降下法とADAM

大規模データでは、目的関数が和で表されることが多い。例えば経験損失

である。このとき全勾配

を勾配推定として用いるのが確率的勾配降下法(SGD)である。

SGDは

で更新し、

ステップ幅の設計が要である。凸最適化では、

のような条件を満たすと収束が保証される理論がある。実務では初期は大きく、後半は小さくするスケジュールが多く、学習率が誤差床を決める形になるのである。

モメンタム法は速度変数を導入する。代表形は

であり、勾配方向の平均を取ることで谷方向に加速し、ノイズにもある程度平滑化効果を持つ。これは二次関数では重い球が斜面を転がるモデルとして解釈でき、振動の抑制に寄与するのである。

適応学習率は座標ごとにスケールを調整する。AdaGradは過去の二乗勾配和

の形にし、頻繁に現れる方向ではステップが小さくなる。これは疎な特徴が多い問題で効果を持つが、

Adamは一次モーメントと二次モーメントの移動平均を併用する。勾配

を計算し、初期バイアスを補正して

とし、

で更新する。二次モーメントが座標ごとのスケール差を吸収し、一次モーメントがモメンタムとして働くのである。

Adamの性質は、勾配のスケールが座標で大きく異なる深層学習で有利になりやすい点にある。一方で、常に良い一般化を与えるとは限らず、最適解近傍での収束挙動や重み減衰との整合が重要になる。そこでAdamWのように、重み減衰を勾配から分離して扱う変種が用いられることも多いのである。

確率的最適化の理解には、確率統計の集中とノイズの分散が直接に関わる。ミニバッチが小さいほど

次の表は更新の要点を整理したものである。

| 手法 | 更新の中心 | 使う統計量 | 進み方の特徴 |

|---|---|---|---|

| GD | 全勾配 | なし | 1回が重いが方向は安定 |

| SGD | ミニバッチ勾配 | 勾配の不偏推定 | 1回が軽いが揺らぎを含む |

| Momentum | 速度の蓄積 | 一次モーメント | 振動を抑え谷方向に加速 |

| AdaGrad/RMSProp | 座標ごとの縮尺 | 二次モーメント | スケール差へ適応しやすい |

| Adam | 一次+二次モーメント | 移動平均と補正 | 深層学習で扱いやすい傾向 |

本章では、凸性が大域最適性を保証すること、制約がラグランジュ乗数とKKT条件で整理できること、双対性が証明と感度を与えること、そして勾配法とその確率的拡張が大規模学習を可能にすることを示したのである。次章では、これらの最適化が実際に学習器の構成へどう組み込まれ、ニューラルネットワークの学習が連鎖律と勾配計算として実装されるのかを数式で述べるのである。

第7章:データからの学習

本章では、データから規則性を獲得して予測や識別を行う学習を、深層ニューラルネットワークを軸に数式で記述するのである。線形代数で現れた行列積・部分空間・ノルムと、確率統計で現れた尤度・損失、最適化で現れた勾配法が、同一の枠組みで結び付くことを確認するのである。

7.1 深層ニューラルネットワークの構成

深層ニューラルネットワークは、線形変換と非線形変換の合成として表される。入力

と定義し、最終出力

この形は、写像

と書け、

活性化関数

深さが増すと表現力が増すという主張は、合成が関数の形を細かく分割できることに対応する。ReLUネットワークの入力空間は多数の線形領域に分割され、それぞれで線形写像として振る舞う。従って深さは、低ランク近似のような単純な表現では捉えにくい複雑な境界を、線形片の組合せとして構成する能力を与えるのである。

一方で、深さは最適化の難しさも増やす。勾配は連鎖律により多層のヤコビアンの積として現れるため、ヤコビアンの特異値が1より小さい方向では勾配が減衰し、1より大きい方向では勾配が爆発し得る。これが勾配消失・勾配爆発として現れ、初期化や正規化、残差構造が重要になるのである。

初期化は、前向き信号と逆向き勾配のスケールを揃えるために設計される。例えば ReLU を仮定したとき、

となるように選ぶと、層を通る信号の分散が過度に変形しにくい。ここで

正規化層は、内部表現の分布を整えることで学習を安定化させる。バッチ正規化はミニバッチ平均

と変換する。これは各層の座標系を動的に整える操作であり、条件数の改善と似た役割を果たすのである。

残差接続は、写像を

の形にする。これにより、恒等写像が常に含まれ、深さを増しても情報の通り道が確保される。線形化するとヤコビアンが

損失関数の選択も構成要素である。回帰では二乗誤差

が基本であり、分類ではソフトマックスと交差エントロピーが基本である。クラス数

と置くと、確率モデルとしての整合が得られ、勾配も解析しやすいのである。

最後に、正則化はネットワークの自由度を制御する。代表的には重みの

があり、これは第6章のラグランジュ形式と同じである。ノルムを抑えることは、局所的なリプシッツ定数やスペクトルノルムを間接的に抑え、過度な増幅を避ける方向に働くのである。

7.2 畳み込みニューラルネットワーク

畳み込みニューラルネットワーク(CNN)は、空間構造を持つデータを効率よく扱うために、局所性と重み共有を組み込んだモデルである。2次元入力

と書くと、これは入力の局所領域に同一の線形作用素を滑らせる操作である。従ってCNNの核は、線形代数の言葉では特殊構造を持つ行列による線形変換である。

畳み込みは行列として表現できる。入力をベクトル化すると

重み共有はパラメータ数を劇的に削減する。全結合層では

同変性は数式で表せる。シフト作用素

を満たす(境界の扱いに依存するが、中心思想は同じである)。この性質により、画像中の位置が異なる同種のパターンを同一のフィルタで検出でき、データ効率が改善されるのである。

ストライドとプーリングはダウンサンプリングである。ストライドは計算点を間引くことにより出力解像度を落とし、平均プーリングや最大プーリングは局所集約により表現を粗視化する。周波数領域の観点では、ダウンサンプリングは折り返し(エイリアシング)と関係するため、平滑化と組み合わせる設計が重要になるのである。

畳み込みの周波数領域表現は、第4章のフーリエ変換と直結する。巡回境界条件を仮定すると、畳み込みはDFTで対角化され

となる。従ってフィルタは周波数ごとの増幅係数として解釈でき、低周波を通す平滑化や高周波を強調するエッジ抽出が自然に説明されるのである。

現代的CNNでは、畳み込みブロックに正規化や残差接続が組み合わされる。これは7.1で述べた勾配伝播の安定化と同じ理由であり、畳み込みが特殊行列であることと矛盾しない。むしろ、巨大行列の反復における前処理と同様に、学習の数値的性質を整える役割を担うのである。

さらに、チャネル次元の扱いはテンソル演算である。入力

7.3 誤差逆伝播法と連鎖律

誤差逆伝播法は、合成写像の微分を効率よく計算する方法である。ニューラルネットワークは層の合成であるから、損失

計算グラフの言葉で、前向き計算が中間変数を生成し、後ろ向き計算が随伴変数(感度)を伝播する。層

と置くと、次の層へは

が伝播する。ここで転置が現れる点は、内積に関する随伴(アジョイント)であり、線形代数の構造そのものである。

線形層

となる。従って学習は、外積

要素ごとの非線形

となる(

分類でよく使うソフトマックスと交差エントロピーは、組として勾配が簡潔になる。ロジット

とすると

が得られる。この形は数値的に安定であり、確率モデルとしての意味も明確であるため、学習の基本部品になっているのである。

逆伝播はヤコビアンの明示的構成を避け、ヤコビアン転置とベクトルの積を逐次計算する。これは線形代数で言えば、巨大行列の作用を明示せずに評価する反復法と同型である。従って深層学習の計算は、疎性やブロック構造を活かしつつ、必要な積だけを高速に計算するという数値計算の哲学に沿っているのである。

数値的安定性にも注意が要る。例えばソフトマックスでは

のように平行移動不変性を用いて安定化する。これは解析上は同値でありながら計算を破綻させないための工夫であり、学習が数値計算であることを示しているのである。

7.4 ハイパーパラメータ:重大な決定

学習率、バッチサイズ、正則化係数、初期化、ネットワークの幅・深さ、活性化、正規化の有無などは、学習結果を大きく左右する。これらは単なる設定値ではなく、統計的にはバイアスと分散、最適化的には収束と安定性、線形代数的にはスペクトルと条件数に対応する。従ってハイパーパラメータは、モデル・データ・計算の三者の整合を取るための数学的選択と捉えるべきである。

学習率

バッチサイズ

正則化係数

初期化は、学習の入り口で勾配の通りを決める。初期重みが大きすぎると活性化が飽和域へ入り勾配が弱くなりやすい。小さすぎると信号が弱くなり表現が育ちにくい。He型やXavier型のような分散設計は、層ごとの入力次元と出力次元に合わせてスケールを整える試みであり、行列の作用が層を通っても破綻しにくいようにしているのである。

ネットワークの幅と深さは、表現力と最適化性質を同時に変える。幅を増せばパラメータ数が増え、表現力は高まるが、過度に自由になるとデータへの当てはまりが強くなり得る。深さを増せば表現の階層化が進むが、勾配伝播の問題が増えるため、残差接続や正規化などの工夫がより重要になる。これらは単独で決めるのではなく、学習率や正則化と組で整合させる必要があるのである。

ドロップアウトは確率的にユニットを無効化する正則化である。訓練時にマスク

のようにし、推定の揺らぎを通じて共適応を抑える。確率統計の観点では、モデル平均化に近い効果を持ち、最適化の観点ではノイズを追加して探索を変形するのである。

データ前処理や特徴スケーリングも影響が大きい。入力のスケールが大きく異なると、同じ学習率でも更新の実効スケールが座標ごとに変わる。これは条件数の悪化として現れ、勾配法の進みを妨げる。従って平均0・分散1への標準化や、画像での正規化は、学習を数値的に扱いやすい座標へ写す操作である。

評価指標と停止規則も設計要素である。訓練損失が下がり続けても、未観測データに対する誤差が改善しないことは起こり得る。そこで訓練用とは別に検証用データを設け、汎化誤差の推定を行う。これは第5章の推定の議論に沿っており、誤差のばらつきがどの程度かを意識する必要があるのである。

7.5 機械学習の世界

機械学習は、観測データから規則性を抽出し、未知データへの予測や推論を行う体系である。教師あり学習では入力

教師あり学習の基本は経験リスク最小化である。データ

を解く。ここで

汎化とは、訓練データでなく真の分布に対する誤差が小さいことである。訓練誤差と汎化誤差の差は、関数族の大きさとデータ数に依存し、過度に柔軟なモデルでは訓練誤差が小さくても汎化が悪化し得る。従って学習は、表現力を増やすだけでは成立せず、正則化・データ拡張・モデル構造などで制約を与えることが不可欠である。

表現学習は、特徴を人手で設計するのではなく、データから中間表現

自己教師あり学習は、教師信号を外部から与えずに、データ自身から学習課題を構成する。例えば一部の情報を隠して予測する課題や、異なる変換で得た表現を一致させる課題により、表現が獲得される。ここでは損失設計が中心となり、確率分布の仮定と情報の保存・不変性の仮定が、最適化問題の形として現れるのである。

モデルの評価では、目的に応じた指標が必要になる。分類では精度だけでなく適合率・再現率、ROCやAUCが用いられ、回帰ではMSEやMAEが用いられる。確率出力を扱うときは対数尤度や校正も重要であり、単に当たるかどうかではなく確率として整合しているかが問われる。これは第5章の確率モデルの選択が、評価の指標と直結することを意味するのである。

学習の計算は行列計算の集合である。前向き計算は主に行列積、逆伝播も行列積と要素積の組合せであるため、計算資源の制約が学習設計に強く影響する。大規模化に伴い、低精度演算、分散計算、近似法が用いられ、ここでも数値線形代数の観点が不可欠になるのである。

本章では、深層ネットワークが線形変換と非線形変換の合成として表され、勾配計算が転置を伴う行列演算として実装されることを示したのである。今後は、表現の設計(同変性や不変性の組込み)、確率モデルとしての整合、そして計算可能性の制約を同時に満たす形で、学習がより大規模・多様なデータへ広がると考えられるのである。

その他参考文献

- Gilbert Strang, Linear Algebra and Learning from Data, SIAM.

- MIT OpenCourseWare, 18.06 Linear Algebra, Lecture Notes / ZoomNotes.

- Stephen Boyd and Lieven Vandenberghe, Convex Optimization, Cambridge University Press.

- Nathan Halko, Per-Gunnar Martinsson, Joel A. Tropp, Finding structure with randomness: Probabilistic algorithms for constructing approximate matrix decompositions.

- Emmanuel Candès, Justin Romberg, Terence Tao, Robust Uncertainty Principles: Exact Signal Reconstruction from Highly Incomplete Frequency Information.

- Ulrike von Luxburg, A Tutorial on Spectral Clustering.

- Diederik P. Kingma, Jimmy Ba, Adam: A Method for Stochastic Optimization.

- Yann LeCun, Léon Bottou, Yoshua Bengio, Patrick Haffner, Gradient-Based Learning Applied to Document Recognition.

- David E. Rumelhart, Geoffrey E. Hinton, Ronald J. Williams, Learning representations by back-propagating errors.

- Peter H. Schönemann, A generalized solution of the orthogonal Procrustes problem.